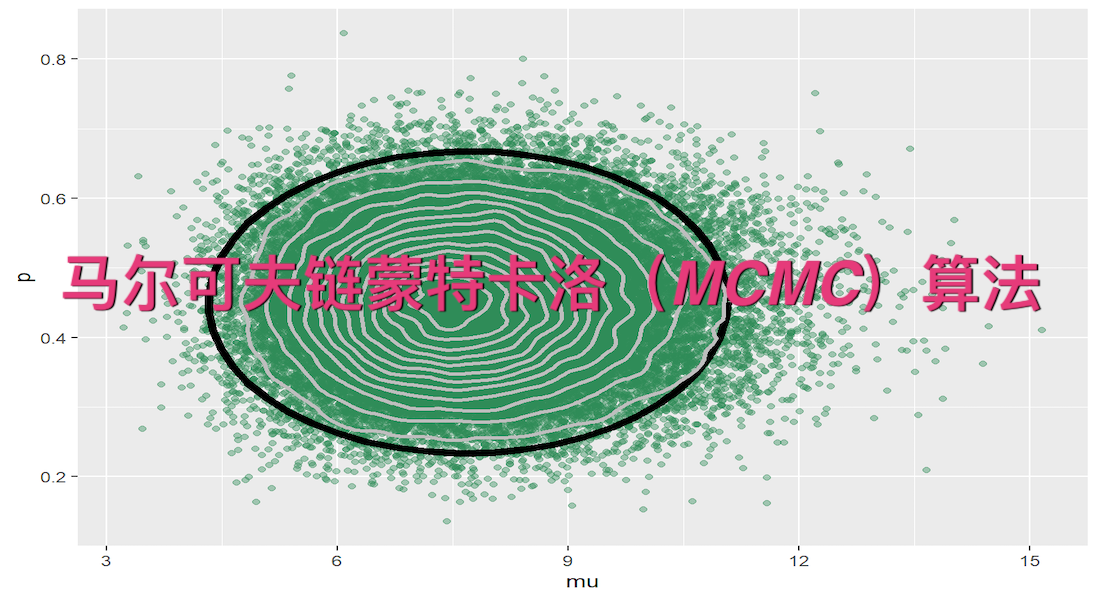

马尔可夫链蒙特卡洛(马尔可夫链蒙特卡洛,简称MCMC)算法,是一类基于随机抽样的统计计算方法,核心作用是从复杂概率分布中高效抽取样本,进而通过样本推断分布的统计特性(如期望、方差、可信区间等)。它巧妙融合了“马尔可夫链”的无记忆性与“蒙特卡洛”的随机抽样思想,解决了传统蒙特卡洛方法在高维空间中抽样效率低下、难以处理复杂分布的痛点,成为贝叶斯统计、计算物理、机器学习等领域的核心工具之一。

简单来说,当目标概率分布过于复杂(如高维、无解析表达式、多峰),无法直接计算或抽样时,MCMC算法通过构造一条特殊的马尔可夫链,让链的平稳分布恰好等于目标分布,经过足够多的迭代后,链的状态就可作为目标分布的样本,用于后续统计推断。

一、基础概念

1.马尔可夫链

马尔可夫链是一种具有“无记忆性”的随机过程,即当前状态的转移仅依赖于前一个状态,与更早的历史状态无关,数学表达为:P(Xₜ₊₁=xₜ₊₁ | Xₜ=xₜ, Xₜ₋₁=xₜ₋₁, ..., X₀=x₀) = P(Xₜ₊₁=xₜ₊₁ | Xₜ=xₜ)。这种无记忆性使得我们只需关注当前状态到下一个状态的转移概率(转移核),无需追踪完整的状态历史,大幅简化了计算复杂度。

2.平稳分布

平稳分布是MCMC算法的核心目标,指当马尔可夫链迭代足够多次(趋于无穷)后,状态的分布不再发生变化,此时的分布即为平稳分布。MCMC算法的关键的是构造转移核,使得马尔可夫链的平稳分布恰好等于我们需要抽样的目标分布。迭代次数越多,样本分布与目标分布的拟合度越高。

3.细致平衡条件

细致平衡条件是保证马尔可夫链拥有平稳分布的关键准则,其数学表达为:π(x)T(x→x') = π(x')T(x'→x),其中π(x)是目标分布,T(x→x')是从状态x转移到状态x'的转移概率。该条件确保了状态转移的双向平衡,使得长期来看,每个状态的流入概率与流出概率相等,最终达到平稳状态。

4.蒙特卡洛思想

蒙特卡洛方法的核心是通过大量随机抽样,用样本均值逼近总体均值,从而解决难以解析计算的积分或概率问题。传统蒙特卡洛方法要求样本相互独立,但在高维空间中难以实现;MCMC算法则放松了“样本独立”的要求,允许样本存在自相关性,通过马尔可夫链生成具有自相关性的样本,同样能通过大数定律逼近总体特性,大幅拓展了蒙特卡洛方法的适用范围。

二、MCMC核心算法分类及原理

MCMC是一类算法的统称,其中最常用、最基础的包括Metropolis-Hastings算法、Gibbs抽样,以及适用于高维场景的Hamiltonian Monte Carlo(HMC)算法,各类算法针对不同场景优化了抽样效率和适用性。

(一)Metropolis-Hastings算法(MH算法)

MH算法是最基础的MCMC算法,由Metropolis等人于1953年提出,核心思路是通过“提议-接受”机制生成马尔可夫链,无需知道目标分布的归一化常数,适用于大多数复杂分布抽样,是后续各类MCMC算法的基础。

算法核心步骤:

1.初始化:随机选择一个初始状态,设定迭代次数和预烧期(Burn-in Period)次数(预烧期内的样本不用于统计推断,用于让链收敛到平稳分布)。

2.提议步骤:基于当前状态,从提议分布中生成候选状态(提议分布通常选择对称分布,如正态分布,简化计算)。

3.接受步骤:计算接受概率α = min(1, [π(x')q(xₜ | x')]/[π(xₜ)q(x' | xₜ)]),其中π(x)是目标分布(可仅用非归一化形式);生成均匀随机数u ~ U(0,1),若u ≤ α,则接受候选状态,令xₜ₊₁ = x';否则拒绝,令xₜ₊₁ = xₜ。

4.迭代更新:重复步骤2-3,完成N次迭代,丢弃前B次预烧期样本,剩余样本即为目标分布的近似样本。

特点:原理简单、适用性广,但抽样效率受提议分布影响较大,易出现“随机游走”现象,在高维空间中效率较低。

(二)Gibbs抽样

Gibbs抽样由Geman兄弟于1984年提出,是MH算法的特例,专门针对高维目标分布设计,通过依次更新每个维度的条件分布,避免了“提议-接受”机制的繁琐计算,抽样效率更高,是高维场景下的首选算法之一。

算法核心前提:假设目标分布为π(x₁, x₂, ..., x_d)(d为维度),每个维度的条件分布π(xᵢ | x₋ᵢ)(x₋ᵢ表示除xᵢ外的其他所有维度)均易于抽样。

算法核心步骤:

1.初始化:随机选择初始状态(x₁⁽⁰⁾, x₂⁽⁰⁾, ..., x_d⁽⁰⁾),设定迭代次数N和预烧期B。

2.维度更新:对于第t次迭代,依次对每个维度i(i=1,2,...,d),基于当前其他维度的状态(x₁⁽ᵗ⁾, ..., xᵢ₋₁⁽ᵗ⁾, xᵢ₊₁⁽ᵗ⁻¹⁾, ..., x_d⁽ᵗ⁻¹⁾),从条件分布π(xᵢ | x₋ᵢ)中抽样,得到xᵢ⁽ᵗ⁾。

3.迭代完成:重复步骤2,完成N次迭代,丢弃前B次样本,剩余样本即为目标分布的近似样本。

(三)Hamiltonian Monte Carlo(HMC)算法

HMC算法受经典力学中的哈密顿动力学启发,引入辅助动量变量,摆脱了传统MCMC算法的“随机游走”困境,能够在高维空间中快速探索目标分布,大幅提升抽样效率,适用于高维、多峰的复杂分布抽样。

核心思路:将状态变量视为“位置”,引入辅助“动量”变量,通过哈密顿方程描述位置与动量的联合运动,利用动力学特性实现长距离、高效的状态转移,减少样本自相关性;运动一段时间后,通过Metropolis接受准则调整,确保链的平稳分布等于目标分布。

特点:抽样效率高,样本自相关性低,适合高维复杂分布;但计算复杂度较高,需要计算目标分布的梯度,且需调优步长、轨迹长度等超参数,对参数设置较为敏感。

(四)其他扩展算法

除上述核心算法外,MCMC还有多种扩展形式,以适应不同复杂场景:

•Metropolis Adjusted Langevin Algorithm(MALA):融合梯度信息优化提议分布,改善多峰、重尾分布的抽样效率。

•数据增强Gibbs抽样:引入潜在变量简化抽样过程,适用于洛伦兹分布等特殊分布的抽样任务。

•Slice抽样:通过引入辅助变量构造“切片”区域,避免随机游走,提升抽样效率,无需调优提议分布参数。

三、MCMC算法的关键步骤与注意事项

(一)核心步骤总结

1.定义目标分布:明确需要抽样的概率分布(可仅提供非归一化形式)。

2.构造马尔可夫链:选择合适的MCMC算法(MH、Gibbs、HMC等),设计转移核,确保链的平稳分布为目标分布。

3.迭代抽样:初始化状态,进行足够次数的迭代,生成马尔可夫链状态序列。

4.样本筛选:丢弃预烧期样本(确保链收敛到平稳分布),保留后续样本用于统计推断。

5.结果验证:检验样本的收敛性,评估样本质量,确保推断结果可靠。

(二)关键注意事项

•预烧期设置:预烧期用于让马尔可夫链收敛到平稳分布,长度需根据实际情况调整(通常为总迭代次数的10%-50%),过短会导致样本未收敛,过长会浪费计算资源。

•收敛性检验:需通过可视化(如轨迹图、自相关图)或定量指标(如Gelman-Rubin检验)验证链的收敛性,避免使用未收敛的样本进行推断,否则会导致结果偏差。

•样本自相关性:MCMC样本存在自相关性,自相关性越强,抽样效率越低,可通过“ thinning”(每隔k个样本保留1个)减少自相关性,但会损失样本量,需权衡取舍。

•超参数调优:提议分布参数(如MH算法的步长)、HMC算法的轨迹长度等超参数,会显著影响抽样效率和样本质量,需通过试错或自适应方法调优。

•维度诅咒:虽然MCMC算法缓解了传统蒙特卡洛方法的维度诅咒,但在极高维度(如数百、数千维)场景下,抽样效率仍会下降,需选择HMC等高效算法,并结合问题特性优化。

四、MCMC算法的应用场景

MCMC算法的核心优势是能够处理高维、复杂、无解析表达式的概率分布,因此广泛应用于多个学科领域,尤其在需要进行贝叶斯推断、复杂系统模拟的场景中不可或缺。

1.贝叶斯统计

贝叶斯推断的核心是计算后验分布π(θ | D) ∝ P(D | θ)P(θ)(θ为参数,D为数据),但高维参数场景下,后验分布难以解析计算。MCMC算法可从后验分布中抽样,进而估计参数的期望、可信区间,实现模型参数推断、模型选择等任务,让大规模分层贝叶斯模型的计算成为可能。

示例:在机器学习中,贝叶斯神经网络的参数推断的,可通过MCMC算法抽样后验分布,获得参数的不确定性估计,提升模型的可靠性。

2.计算物理与统计力学

用于模拟复杂物理系统的微观状态,如液体分子运动、粒子系统的能量分布等。通过MCMC算法抽样系统的平稳分布,可估算系统的平均能量、熵等物理量,解决传统方法难以模拟的复杂系统问题——这也是MCMC算法最初的诞生场景(1953年用于模拟液体分子运动)。

3.计算生物学与生物信息学

应用于基因序列分析、蛋白质结构预测、分子动力学模拟等任务。例如,通过MCMC算法抽样蛋白质的可能构象,寻找能量最低的稳定结构;或分析基因表达数据,推断基因之间的调控关系。

4.工程与故障预测

在工业设备故障预测中,可通过MCMC算法对设备故障数据进行抽样估计,确定故障发生次数的分布参数,结合浴盆曲线修正参数,进而预测故障发生时间,为设备预防性维修提供依据。例如,露天矿电铲、卡车等大型设备的故障预测,可通过MCMC算法提升预测精度,降低维修成本和安全风险。

5.其他领域

还广泛应用于计算语言学(如语言模型参数估计)、天体物理学(如宇宙学参数推断)、金融工程(如风险评估、期权定价)、罕见事件抽样(如生成故障区域样本)等场景,成为跨学科的通用计算工具。

五、MCMC算法的优势与局限性

1.优势

•适用性广:无需目标分布的解析表达式,仅需知道其非归一化形式,可处理高维、多峰、重尾等各类复杂分布。

•计算灵活:无需大量数学推导,通过随机抽样即可实现统计推断,可适配不同场景调整算法(如高维用Gibbs、HMC,低维用MH)。

•结果可靠:通过足够多的迭代,样本可无限逼近目标分布,基于大数定律的推断结果具有一致性。

2.局限性

•抽样效率较低:样本存在自相关性,尤其是高维场景下,需大量迭代才能获得足够多的有效样本,计算成本较高。

•收敛性难以判断:链的收敛速度受初始状态、超参数等影响,收敛性检验仅能提供近似判断,无法保证绝对收敛。

•超参数敏感:提议分布步长、HMC轨迹长度等超参数的设置,对抽样效率和样本质量影响极大,调优难度较高。

六、总结

MCMC算法是一类革命性的随机抽样与统计计算方法,通过融合马尔可夫链的无记忆性与蒙特卡洛的随机抽样思想,打破了传统方法处理复杂分布的局限,成为贝叶斯推断、复杂系统模拟等领域的核心工具。从基础的MH算法到高效的HMC算法,MCMC家族不断发展,适配不同维度、不同复杂度的应用场景,解决了高维积分、复杂分布抽样等长期以来的难题。

尽管MCMC算法存在抽样效率、收敛性判断等局限性,但随着自适应算法、并行计算技术的发展,其性能不断提升,应用范围也持续拓展,在人工智能、物理、生物、工程等多个领域发挥着不可替代的作用。理解MCMC算法的核心原理与应用场景,是掌握现代统计计算、贝叶斯方法的关键基础。