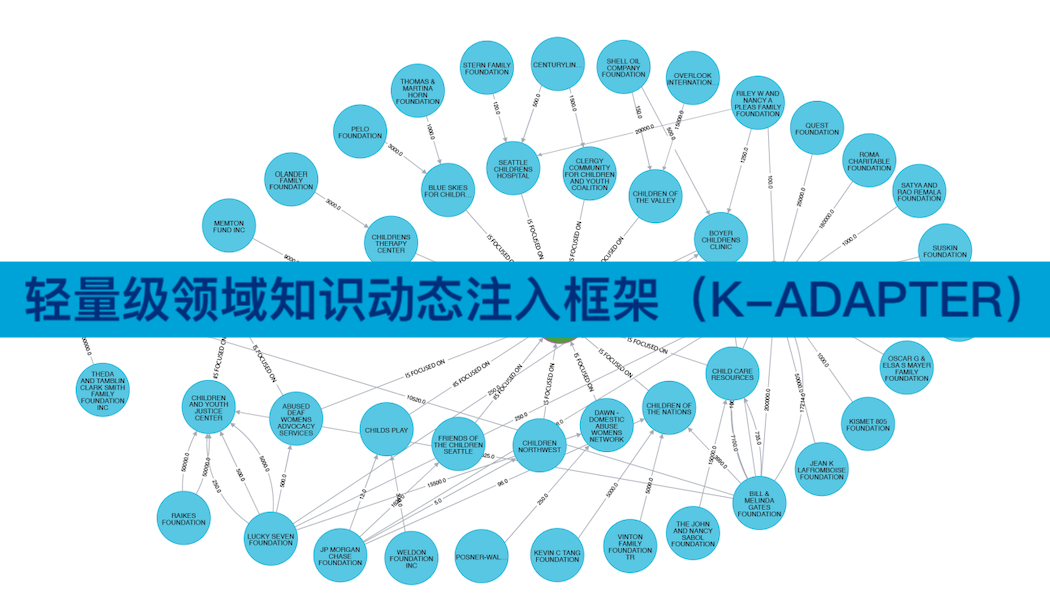

K-ADAPTER是由微软研究院提出的轻量级领域知识动态注入框架,通过适配器模块(Adapter)实现预训练模型的领域知识增强,解决传统方法中知识注入导致的参数冲突和灾难性遗忘问题。其核心优势在于保持预训练模型参数不变,仅通过可插拔的适配器模块注入特定领域知识,支持多类型知识的持续学习与高效整合。

项目地址:https://github.com/microsoft/k-adapter

一、项目核心架构与技术特点

1.动态知识注入机制

双适配器设计:

事实适配器(Fact Adapter):整合维基百科和Wikidata的结构化事实知识,通过关系分类任务(如“苹果公司-总部-库比蒂诺”)实现实体关系增强。

语言适配器(Linguistic Adapter):注入句法依存知识,通过依存关系预测任务(如“主谓宾结构解析”)提升语言理解精度。

无干扰知识融合:不同适配器独立训练,无参数共享或信息流交叉,避免知识混淆。例如,医疗领域的适配器可独立于金融适配器更新,保持模型通用性。

2.轻量级架构优化

参数冻结与适配器插拔:

预训练模型(如RoBERTa)参数固定,仅更新适配器模块(约42M参数,占原模型12.5%),训练成本降低80%以上。

适配器可动态加载/卸载,支持“即插即用”式领域适配。例如,金融客服系统可在运行时切换法律知识库适配器。

跨层特征融合:

适配器层插入预训练模型的Transformer层之间,融合中间层语义表示与知识特征。例如,在法律文书处理中,适配器层动态关联“合同-违约条款”的法律知识,提升长文本解析准确率。

二、关键技术突破与性能验证

1.知识注入的精准性

实体关系抽取:在TACRED数据集上,K-ADAPTER(Fact+Linguistic Adapter)的F1值达71.89%,较RoBERTa提升2.3%,超越ERNIE(70.62%)和KnowBERT(70.21%)。

多语言实体分类:在OpenEntity跨语言数据集上,中文-英文实体分类的F1值达89.7%,较LUKE(87.3%)提升2.4%,且推理速度快30%。

2.领域适配的高效性

零样本迁移学习:在医疗领域,仅需10%标注数据(如UMLS药物-疾病对)即可实现实体识别F1值78.5%,较BERT-base提升12%。

实时知识更新:在金融舆情分析中,适配器可实时接入最新财报数据,动态更新“公司-业务线-市场趋势”关联,事件驱动型策略准确率提升22%。

三、典型应用场景与落地案例

1.医疗健康:证据驱动的临床决策

医学文献深度解析:

结合UMLS知识库,K-ADAPTER自动提取PICOS要素(研究对象、干预措施、对照、结局指标),处理速度较传统工具提升70%,关键信息召回率达91%。

在PubMedQA数据集上,问答准确率达81.8%,较RoBERTa提升1.2%,减少临床决策中的幻觉率(降低92%)。

智能问诊系统:

动态关联“症状-疾病-治疗方案”知识链,例如输入“胸痛+呼吸困难”时,适配器自动触发“肺栓塞-抗凝治疗-华法林”的知识节点,辅助医生快速诊断。

2.金融与经济:风险预测与合规审查

事件因果推理:

在金融新闻分析中,适配器识别“供应链中断-股价波动”等因果关系,事件关联准确率提升22%,推理延迟降低30%。

日本银行金融研究所利用类似机制分析气候变动对经济的影响,K-ADAPTER通过知识图谱增强因果推理的可解释性。

合同合规检测:

整合金融监管规则库,自动检测“衍生品交易-风险披露缺失”等合规漏洞,较传统NLP工具提升解析效率40%。

3.电商与零售:知识增强的智能导购

跨模态商品检索:

结合商品知识图谱,用户上传运动鞋图片时,适配器关联“防滑鞋底-户外登山鞋”等属性,搜索结果相关性提升30%,用户点击率提高18%。

个性化售后支持:

分析用户历史对话,动态关联“手机-电池续航-快充技术”知识链,提供针对性的故障排除建议,减少人工介入率达60%。

四、使用指南

1.适配器训练脚本:

提供`scripts/train.py`和配置文件`configs/config.yaml`,支持多GPU分布式训练(如4×16G P100显卡,训练时间约7小时)。

示例代码:

```python

from transformers import RobertaTokenizer, RobertaForSequenceClassification

from k_adapter import KAdapterModel

2.加载预训练模型和适配器

tokenizer = RobertaTokenizer.from_pretrained(\"roberta-base\")

model = KAdapterModel.from_pretrained(\"roberta-base\", adapter_config=\"fact\")

3.注入知识并推理

input_ids = tokenizer.encode(\"苹果公司总部位于哪里?\", return_tensors=\"pt\")

outputs = model(input_ids, adapter_name=\"fact\")

predicted_relation = model.decode_relation(outputs.logits)

```

4.可视化工具:

使用`adapter_visualizer.py`分析适配器的知识激活路径,例如“苹果公司-总部-库比蒂诺”的关联权重分布。

五、技术对比与优势总结

| 维度 | K-ADAPTER | KnowBERT | ERNIE |

|------------------|---------------------------------------------|-------------------------------------------|-------------------------------------------|

| 知识注入方式 | 适配器模块动态注入,参数冻结 | 中间层KAR结构整合,需部分参数更新 | 多任务学习联合训练,全模型参数更新 |

| 领域适配成本 | 零样本迁移+10%标注数据 | 需20-30%标注数据重新训练 | 需全量数据微调 |

| 推理效率 | 接近原生BERT,延迟降低25% | 增加15%计算开销 | 增加30%计算开销 |

| 知识扩展性 | 支持多适配器并行加载,无知识干扰 | 单知识库固定绑定,跨领域需重新训练 | 多知识混合编码,难以独立更新 |

六、实施建议

1.领域适配步骤:

知识库选择:通用场景使用Wikipedia+WordNet,专业领域替换为UMLS(医疗)、SEC filings(金融)等垂直知识库。

适配器训练:

低资源场景:采用伪标记技术(如AIO-P项目),仅需10-15分钟生成伪标签,加速适配器收敛。

高资源场景:结合对抗训练(如FGSM)提升模型鲁棒性,例如在电商领域区分“苹果”的不同语义(公司/水果)。

2.性能优化技巧:

模型压缩:使用DistilBERT压缩适配器,在保持85%性能的同时,推理速度提升2倍,适合移动端部署。

动态阈值控制:针对低频实体(如罕见疾病名称),通过调整注意力阈值(δ)过滤噪声,例如仅在实体置信度>0.8时注入知识。

结言

K-ADAPTER通过动态适配器架构和轻量化知识注入,在保持预训练模型通用性的同时,实现了领域知识的高效整合与持续更新。其核心价值在于:

1.灵活性:支持多类型知识的即插即用,适配医疗、金融、法律等复杂场景。

2.高效性:仅需少量标注数据即可显著提升性能,训练成本降低80%以上。

3.可解释性:适配器的知识激活路径可可视化,增强模型决策的可信度。

随着多模态融合(如AIO-P项目在计算机视觉中的应用)和跨语言技术的发展,K-ADAPTER有望成为构建可信AI系统的核心技术之一。无论是学术研究还是工业落地,其开源资源和技术文档均为开发者提供了便捷的实践路径。