随着大语言模型技术快速迭代,人工智能行业进入大规模参数模型普及阶段。传统稠密大模型依靠海量参数堆叠获得强大通用能力,但存在算力消耗大、推理成本高昂、部署门槛严苛等现实痛点。为解决稠密模型算力冗余问题,稀疏大模型凭借按需激活的架构设计快速兴起,成为当前大模型轻量化、低成本化的重要发展方向。稠密大模型与稀疏大模型代表了两种截然不同的模型设计思路,二者在激活机制、计算逻辑、性能表现以及落地场景上存在显著差异。

一、基本概念与核心原理

1.稠密大模型

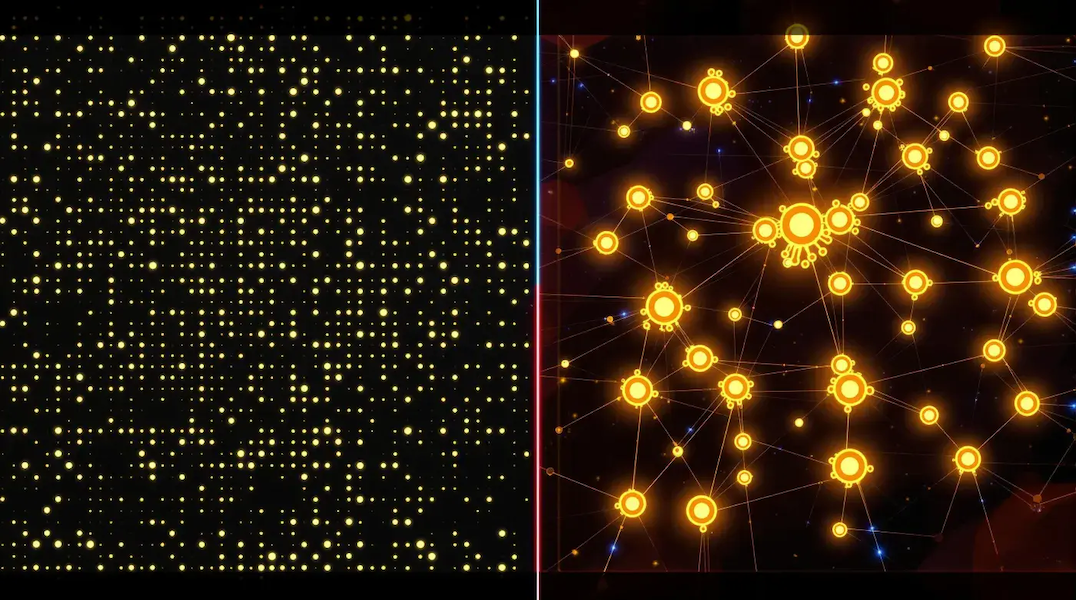

稠密大模型(Dense LLM)是传统主流大语言模型架构,采用全参数激活机制。在每一次前向传播计算过程中,模型内部所有权重参数、神经元都会参与运算,无论输入文本简单或是复杂,网络结构均保持完整计算状态。该模型延续Transformer基础架构,依靠全部参数共同拟合语言规律,参数容量直接决定模型通用能力,模型能力随参数量增加呈现稳定提升趋势。目前主流通用底座模型大多为稠密结构,例如LLaMA、Qwen稠密版本等。

2.稀疏大模型

稀疏大模型(Sparse LLM)是优化改进后的新型模型架构,核心特征为参数非全时激活。行业普遍将稀疏率不低于70%的模型判定为稀疏模型,即单次推理过程中仅有少部分参数参与计算,绝大多数参数处于休眠闲置状态。稀疏模型模仿人脑神经元选择性激活机制,通过静态剪枝或动态路由的方式筛选有效计算单元,仅针对输入任务调用适配的神经元或专家网络,实现“按需计算、专人专事”。常见实现方式包含权重稀疏、激活稀疏、注意力稀疏三大类别,其中MoE混合专家架构是当前工业界落地最成熟的稀疏方案。

二、两类模型多维度对比分析

1.激活机制差异

激活机制是两类模型最本质的区别。稠密大模型采用全局激活模式,单次计算遍历全部参数,计算逻辑简单规整,无参数筛选过程;稀疏大模型采用差异化激活模式,分为静态稀疏与动态稀疏,静态稀疏通过剪枝固化零值权重,动态稀疏依靠路由算法实时激活少量有效参数,计算具备极强任务针对性。

2.算力与推理性能对比

稠密模型算力开销随参数量呈指数级增长,参数量越大,显存占用、计算耗时越高,大参数量稠密模型必须依托高端GPU集群完成训练与推理。稀疏模型打破算力绑定关系,算力开销随参数量近似线性增长,单次计算量大幅减少,在同等硬件条件下,稀疏模型推理速度可达稠密模型的3至5倍,并发处理能力优势明显。

3.硬件部署适配性

稠密模型硬件门槛极高,超大参数量版本仅能部署在专业算力服务器,难以适配边缘终端与消费级硬件;稀疏模型存在大量零值参数,可通过压缩算法缩减存储体积,且单次激活参数少、显存占用低,能够兼容普通显卡、嵌入式设备等轻量化硬件,大幅降低大模型落地部署成本。

4.泛化能力与稳定性

稠密模型凭借全参数协同运算,通用泛化能力优异,上下文连贯度高,短句、简单指令等低复杂度场景稳定性极强,文本生成质量均衡。稀疏模型垂直领域表现优异,专业任务精度可持平稠密模型,但路由算法存在局限性,在简单短句、模糊输入场景下易出现激活偏差,生成稳定性略逊于稠密模型。

综合上述维度,可对两类模型核心差异进行归纳梳理:在激活机制上,稠密大模型实行全部参数全时激活,而稀疏大模型采用动态或静态方式仅激活少量参数;在算力开销层面,稠密模型算力随参数量指数增长,稀疏模型算力则呈线性增长;推理性能方面,稠密模型推理速度慢、延迟偏高,稀疏模型推理更快、业务吞吐量大;在显存与存储上,稠密模型资源占用高且压缩难度大,稀疏模型占用更低,依托零值参数具备良好压缩特性;硬件适配层面,稠密模型依赖高端GPU与算力集群,稀疏模型硬件门槛更低,可适配普通硬件设备;在泛化稳定性上,稠密模型通用性强、生成过程稳定,稀疏模型在垂直领域表现优异,但简单输入场景下输出存在波动。

三、优劣分析与现存痛点

1.稠密大模型优劣

稠密模型优势在于结构简单、训练成熟、通用性强,无路由筛选误差,文本生成流畅自然,适配绝大多数通用自然语言任务,调试与优化技术体系完善。但其短板十分突出,算力资源消耗巨大、训练推理成本昂贵,参数量扩容受硬件限制明显,难以在低成本终端大规模普及,商业化落地运维压力较大。

2.稀疏大模型优劣

稀疏模型核心优势为算力成本低、推理效率高、扩容能力强,可在不显著损失专业任务精度的前提下扩大模型参数量,适配边缘部署与高并发服务场景。目前稀疏模型仍存在技术短板,动态稀疏架构训练难度高、调参复杂,非结构化稀疏权重硬件适配性差,MoE架构易产生显存碎片化问题,且简单文本生成稳定性有待优化。

四、应用场景适配划分

1.稠密大模型适用场景

稠密模型适合对文本流畅度、生成稳定性、通用泛化能力要求极高的场景,例如通用智能对话、创意文案生成、多模态综合交互、高精度翻译等。同时,科研基础底座训练、通用评测基准测试也优先选用稠密模型,保障模型综合能力无偏差输出。

2.稀疏大模型适用场景

稀疏模型侧重低成本、高吞吐、长文本处理场景,包括大规模批量推理、企业高并发AI服务、超长文档解析、代码上下文理解等。此外,嵌入式终端、轻量化服务器、垂直行业定制模型(金融、医疗、法律)均适配稀疏架构,依靠专属专家模块提升专业任务处理效率。

五、行业发展趋势

当前大模型行业逐步摆脱单纯堆叠参数的发展模式,走向高效优化、成本可控的技术路线。稠密模型仍为通用基础底座的核心选择,持续优化精度与稳定性;稀疏模型依托MoE架构、半结构化稀疏、稀疏注意力等技术快速迭代,逐步解决硬件适配、路由不稳定等痛点。未来两类模型不会出现单向替代关系,而是形成互补发展格局:稠密模型负责通用高质量生成,稀疏模型承担低成本规模化部署。同时,稀疏与量化、蒸馏技术的融合优化,以及芯片厂商对稀疏矩阵计算的原生适配,将成为行业主流发展方向,推动大模型实现普惠化、轻量化落地。

六、结语

稠密大模型与稀疏大模型代表了大语言模型两种核心设计理念:稠密模型追求全参数协同、极致通用,稀疏模型坚持按需激活、高效低成本。二者没有绝对优劣之分,仅存在场景适配差异。稠密模型是通用智能的基石,稀疏模型是规模化落地的关键。随着技术不断完善,两类模型将协同发展,共同平衡大模型性能、成本与落地难度,持续推动人工智能技术向产业化、平民化方向进阶。